https://es.wikipedia.org/wiki/Isaac_Asimov

https://es.wikipedia.org/wiki/Rob%C3%B3tica

https://es.wikipedia.org/wiki/Ingenier%C3%ADa_mecatr%C3%B3nica

https://es.wikipedia.org/wiki/Ingenier%C3%ADa_de_sistemas

| Isaac Asimov | ||

|---|---|---|

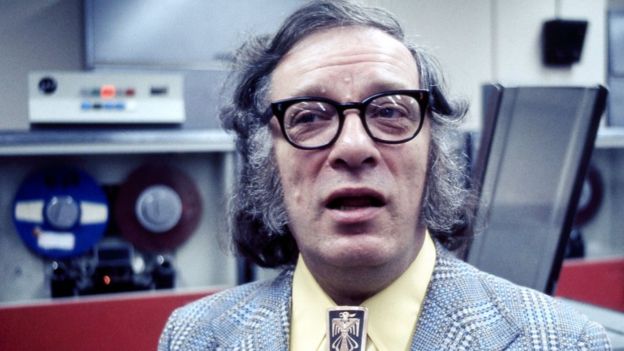

Isaac Asimov en 1965 | ||

| Información personal | ||

| Nombre de nacimiento | Isaak Yudovich Ozimov | |

| Nacimiento | 2 de enero de 1920 | |

| Fallecimiento | 6 de abril de 1992 (72 años) | |

| Causa de muerte | Sida, insuficiencia renal e insuficiencia cardíaca | |

| Residencia | Brooklyn y Petróvichi | |

| Nacionalidad | Estadounidense | |

| Lengua materna | Inglés | |

| Religión | Ateísmo | |

| Partido político | Partido Demócrata | |

| Familia | ||

| Cónyuge | Gertrude Blugerman (1942-1973, divorciados) Janet Opal Jeppson (1973-1992) | |

| Hijos | David (1951) Robyn Joan (1955) | |

| Educación | ||

| Alma máter |

| |

| Información profesional | ||

| Ocupación | Escritor, historiador, profesor de bioquímica y divulgador científico. | |

| Empleador | ||

| Seudónimo | Paul French, en la saga Lucky Starr | |

| Género | Ciencia ficción (hard SF), novela, Cuento, ficción de misterio, Ensayo, Divulgación científica, Historia, crítica literaria, humor | |

| Movimientos | Edad de Oro de la ciencia ficción | |

| Obras notables | La Saga de la Fundación La Serie de los robots Anochecer Nueva guía de la ciencia Yo, robot | |

| Rama militar | Ejército de los Estados Unidos | |

| Participó en | Segunda Guerra Mundial | |

| Miembro de | ||

| Distinciones | Véase Reconocimientos | |

| Firma |  | |

| Web | ||

| Sitio web | ||

| [editar datos en Wikidata WIKIPEDIA | ||

Derechos de autor de la imagen Getty Images

Derechos de autor de la imagen Getty Images

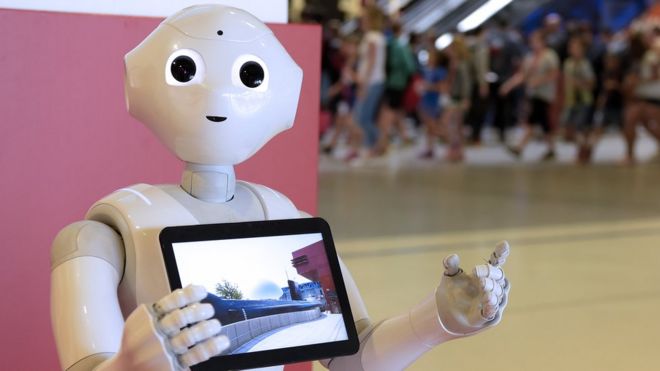

El escritor de ciencia ficción Issac Asimov escribió sobre las tres leyes que se deberían usar para controlar a las máquinas inteligentes:

- Un robot no debe herir a un ser humano ni tampoco, a través de la inacción, debe permitir que éste salga lastimado.

- Un robot debe seguir órdenes impartidas por seres humanos, excepto cuando estas órdenes vayan en contra de la primera ley.

- Un robot debe proteger su propia existencia, siempre y cuando esa protección no entre en conflicto con la primeras dos leyes.

Como tantas veces sucede, la ciencia ficción se ha convertido en ciencia fáctica.

Un informe publicado por la Real Sociedad y la Academia Británica sugiere que no debería haber tres sino un solo principio fundamental para gobernar a las máquinas inteligentes que pronto vivirán entre nosotros:

"Los seres humanos deben prosperar".

Según la profesora Dama Ottoline Leyser, quien codirige el grupo de consejeros de políticas científicas de la Real Sociedad, la prosperidad de los seres humanos debería ser la clave detrás de cómo son gobernados los sistemas inteligentes.

"Ese fue el término que realmente resumió lo que quisimos decir", le dijo a la BBC.

El informe sugiere la creación de un nuevo organismo que garantice que las máquinas sirvan a las personas, en vez de controlarlas.

Considera que un sistema de supervisión democrático es esencial para regular el desarrollo de sistemas que se enseñan a sí mismos.

Sin ello estas máquinas tienen el potencial de causar mucho daño, asegura.

No advierte sobre la posibilidad de que las máquinas esclavicen a los seres humanos, al menos no por el momento.

Pero señala que cuando se usan sistemas que aprenden y toman decisiones de forma independiente en un hogar o para proveer un gran número de servicios comerciales y públicos, se abre la posibilidad de que ocurran muchas cosas malas.

El informe pide que se implementen medidas de protección para priorizar los intereses de los humanos por sobre las máquinas.

Y afirma que el desarrollo de estas máquinas no puede ser gobernado únicamente usando estándares técnicos.

Antony Walker, subdirector del grupo de lobby TechUK y otro de los autores del trabajo, señaló que también deben tomarse en cuenta los valores éticos y democráticos.

"Se obtendrán muchos beneficios gracias a estas tecnologías, pero el público debe tener confianza en que estos sistemas están bien pensados y se regularán de forma correcta", afirmó.

La era de Asimov

El informe sugiere que el tema se encare de una forma totalmente novedosa.

Plantea que un "cuerpo administrativo" formado por expertos y personas involucradas en el tema creen un marco ético para el desarrollo de tecnologías que usan la inteligencia artificial.

Recomienda cuatro principios supremos para promover la prosperidad humana:

- Proteger los derechos e intereses individuales y colectivos.

- Garantizar la transparencia, responsabilidad e inclusión.

- Buscar las buenas prácticas y aprender del éxito y del fracaso.

- Mejorar el sistema actual de gobierno democrático.

Y dice que es urgente crear este nuevo marco para gobernar a las máquinas porque la era de Asimov ya llegó.

El desarrollo de autos autónomos, por ejemplo, abre interrogantes sobre cómo se debe priorizar la seguridad de los humanos.

¿Qué pasaría en una situación en la que la máquina tiene que elegir entre la seguridad de quienes están dentro del vehículo y la de los peatones?

También hay que determinar las responsabilidades en casos de accidentes.

¿Es culpa del dueño del auto o de la máquina?

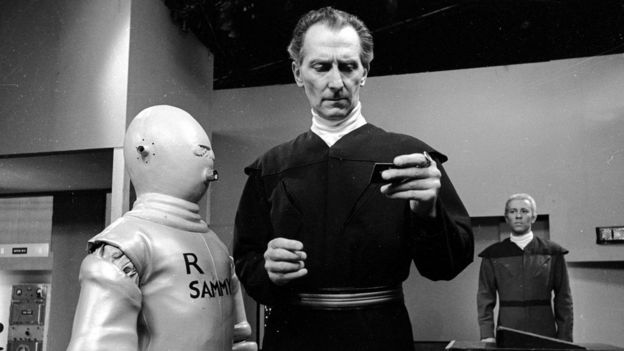

Derechos de autor de la imagen Getty Images

Derechos de autor de la imagen Getty Images

Otro ejemplo es el surgimiento de sistemas inteligentes de instrucción personal.

Estos identifican las fortalezas y debilidades de un estudiante y le enseñan con base en eso.

¿Debería permitírsele a un sistema así que enseñe sin normas claras?

¿Cómo podemos estar seguros de que estamos cómodos con la manera en que la máquina guía al niño, de la misma forma que nos preocuparíamos por cómo le enseña un maestro?

Estos no son temas que tengan que resolver las empresas tecnológicas que desarrollan los sistemas, nos conciernen a todos.

Es por este motivo que el informe señala que los detalles de los sistemas inteligentes no pueden permanecer secretos por cuestiones comerciales.

Deben ser accesibles para el público, para que si algo empieza a andar mal pueda ser detenido y corregido.

Hoy las normas se enfocan en los datos personales.

Pero no dicen nada sobre toda la información que regalamos a diario a través de la localización de nuestro celular, nuestras preferencias de compra, los reguladores inteligentes de electricidad y los "me gusta" que damos online.

Hay sistemas que puedan unir toda esta información y construir un perfil de personalidad que potencialmente podría ser usado por compañías de seguros para determinar ciertas primas o por empleadores para determinar la aptitud para ciertos trabajos.

Estos sistemas pueden ofrecer enormes beneficios, pero si no los vigilamos podríamos encontrar que nuestras posibilidades en la vida están determinadas por máquinas.

Derechos de autor de la imagen Getty

Derechos de autor de la imagen Getty

La clave, según la profesora Leyser, es que los reglamentos se deben hacer caso por caso.

"Un algoritmo que predice qué libros se te debería recomendar en Amazon es algo muy distinto a usar un algoritmo para diagnosticar una enfermedad en un contexto médico", le explicó a la BBC.

"De modo que no tiene sentido regular todos los algoritmos por igual sin tomar en cuenta para qué se usan".

El Partido Conservador británico prometió en su manifiesto la creación de un acta digital y una comisión sobre el uso ético de los datos digitales.

Mientras que la mayoría de los discursos políticos se refieren a frenar el uso de internet para incitar al terrorismo y a la violencia, algunos creen que el acta y la comisión podrían también adoptar algunas de las ideas propuestas en este informe.

El ministro de Asuntos Digitales británico, Matt Hancock, le dijo a la BBC que era "esencial" establecer las normas correctas sobre el uso de los datos como sociedad.

"El manejo de los datos y el uso efectivo y ético de la información son vitales para el futuro de nuestra economía y nuestra sociedad", señaló.

"Nos comprometemos a seguir trabajando con la industria para lograr el mejor resultado", agregó.

En esencia, los sistemas inteligentes solo despegarán si las personas confían en ellos y en cómo están siendo regulados.

Sin eso, el enorme potencial que tienen para mejorar la prosperidad humana nunca se alcanzará.

Temas relacionados

En otros sitios BBC

Guillermo Gonzalo Sánchez Achutegui

ayabaca@gmail.com

ayabaca@hotmail.com

ayabaca@yahoo.com

Inscríbete en el Foro del blog y participa : A Vuelo De Un Quinde - El Foro!

No hay comentarios:

Publicar un comentario